検索上位表示のために内部SEOでやってはいけない事

- サイトダウン

- メタデータの重複

- 過剰な外部リンク

- 重複コンテンツ

- サイトの読み込みが速度が遅い

- サイトの動作不良

- 自動生成コンテンツと自動編集

- どこにでもあるコンテンツ

- 背景色と同じ、または近い文字色を使用する

- サブドメインとサブディレクトリ

- 著作権違反

- ドアウェイページ

- 過剰な広告とページレイアウト

- 過剰な内部リンクとフッターリンク

- 過剰なキーワード出現率と長いURL

- タイトルタグが長すぎる

- パークドメインと中古ドメイン

- 箇条書きが多すぎるコンテンツ

- アフィリエイトサイトでの販売者サイトとの記事重複

- 太文字や斜体文字などを多用する

- 過剰な動的コンテンツ

- ポップアップウィンドウとインタースティシャル広告

- ペナルティを受けているサイトへのリンク

- 画像内、動画内のテキスト

内部SEOでマイナスに働く必要な対策-24

このコンテンツの内容は比較的初心者さんでも実践しやすく、「やってはいけない」という内容なので、サイト作成上初期的なミスが防げます。

また、ページの作成後においてミスに気付いた場合、修正作業でかなり手間がかかる事例や、当初の検索順位にも影響が及ぶ内容もありますので、一読する事をお勧めします、

---このページの使い方---

- 下記リンクより解説先に飛ぶ事ができます。

- 当ページは縦に相当長くなっています。

- 各LEVELの最後に[ページトップに戻るボタン]を付けています。

- サイトダウン

- メタデータの重複

- 過剰な外部リンク

- 重複コンテンツ

- サイトの読み込みが速度が遅い

- サイトの動作不良

- 自動生成コンテンツと自動編集

- どこにでもあるコンテンツ

- 背景色と同じ、または近い文字色を使用する

- サブドメインとサブディレクトリの使用

内部SEOでマイナスに働く要因

サイトダウン

作成したサイトがメンテナンスやサーバーのダウンでアクセスできない(見れない)状態が一週間程度連続すると、グーグルのインデックスからサイトが削除される可能性があります。サイトが削除されるって事は検索結果にまったく表示されないという事です。

またアルゴリズムのサイトに対する評価で、エクスペリエンス(快適度指数)が低いと判断されグーグルからの信頼性が低くなります。2〜3日程度の一時的なものであれば問題ありませんが、それ以上になると検索順位に影響がでる恐れがあります。

サイトを運営する以上、常に見れる状態を保つ必要があるという事です。

アクセスできないサイトに価値無し

メタデータの重複

メタデータの記述を重複させると、アルゴリズムによってフィルタリングされ、検索結果にページが表示されない事態が発生する可能性があります。

ここで言うメタデータとは、「トップページ」、「各ページ」、「カテゴリーページ」のタイトルタグとメタディスクリプション(ページ説明文)です。

これらのメタデータは、そのページごとにコンテンツの内容に即した、それぞれ個別の記述が求められます。ソフトによっては自動的にトップページやカテゴリーページの記述がそのままコピーされたりする事がミスの原因です。

検索結果でユーザーに少しでも多くクリックしてもらう事も考えれば、当然ページごとのメタ情報は違ったものになるはずです。これはサイト作成の第一歩で超基本的なSEO対策になります。時間と手間のかかる作業になりますが、確実に実践する必要があります。

ページ数が増えてくると、これらの情報の管理に時間がかかります。

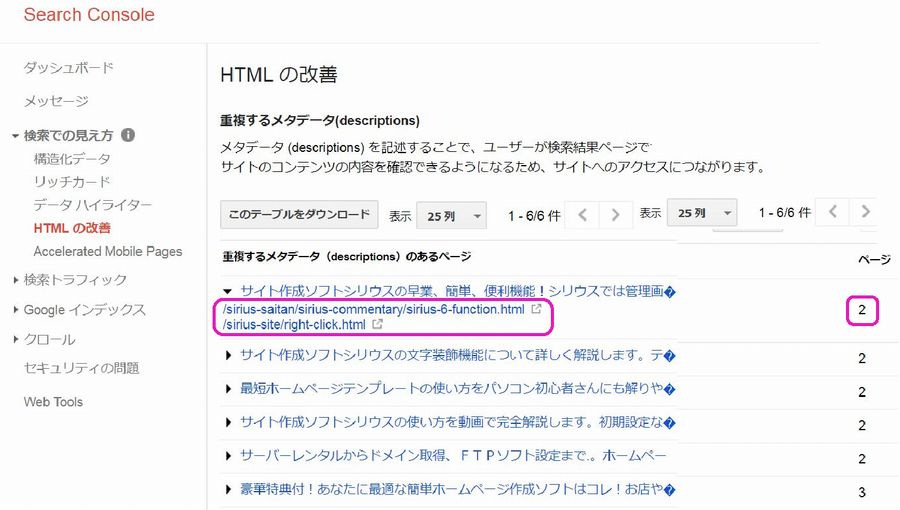

グーグルではサーチコンソールのカテゴリーで「検索での見え方」の中の機能である「HTMLの改善」として、メタデータの重複を確認できるコンテンツがあります。

下記の画像では、「重複するメタデータ」が13ページ、また「タイトルタグの重複」が、8ページ存在する事が一目で解ります。重複があった場合これらの警告はリンクで表示され、そのページのURLが表示されます。

「重複するメタデータ」の警告リンクをクリックし、そのURLの確認画面が下記の画像です。重複しているURLもリンク表示となり、そのページがブラウザで確認できます。

グーグルがツールでミスを警告するくらいなので、いかに大切な対策であるかが解ります。この「HTMLの改善」では他にも基本的なメタデータの必要な改善事項が確認できますので、初心者の方も必ずサーチコンソールを登録しておいて下さい。

メタデータの最適化はサイト作成の第一歩

過剰な外部リンク

ページランク、クオリティが高いサイトに対して外部リンクを貼る事は有効なSEO対策ですが、過剰にやり過ぎると返ってSEOではマイナス要因になってしまいます。

元々外部に対するリンクは、自分のサイトのページランクを外に流出させます。当然の事ながらやり過ぎは、サイトの価値を外に流しっぱなしになるので不利になる訳です。

じぁ、どうすれば良いのかという事になります。

通常のサイト作成では必要な場合に、状況に応じて必要なサイトに対してリンク付けすると言う意識で大丈夫です。あくまでも外部リンクは検索順位をあげるためのものではなく、ユーザーがより便利にサイトを使えるようにするためのものです。

SEO対策のために外部リンクを付けるという意識を無くし、あくまでもユーザビリティを考えたリンク付けであれば、自然に適度な数に落ち着くはずです。

SEOでは施策のやり過ぎがマイナス要因

重複コンテンツ

他のサイトと記事の内容が極似し、重複している場合、あきらかに検索順位に悪い影響を与えます。他サイトの記事を引用する場合はその出典方法に規則がありますが、このルールを守り、引用タグをつかったとしてもSEOではマイナス要因になります。

■ HTMLの引用タグ

<blockquote>

〜引用記事〜

</blockquote>

出典の規則とは、上記のようにblockquoteタグで引用記事を囲んで、引用先の文章の作者、執筆年月日、URL等を記載するというものです。

しかしよほどの事がない限りこのようなタグを使ったとしても、オリジナルでない文章を自分のサイトに掲載するのは避けたほうが良いです。

引用タグを使って、引用したコンテンツだということをアルゴリズムに明示したとしても、グーグルには重複と見なされると考えて下さい。

また、あなたのサイトの記事を他サイトに盗用された場合でも、相手サイトがオリジナルとグーグルに判断された場合は、あなたのサイトが重複と判断されます。このような場合は権利侵害としてグーグルに通知して改善させる事が可能になっています。

■ 著作権侵害による削除の以来先・・・著作権侵害の報告

■ グーグルの見解文章<blockquote>で囲っています。

他サイトとコンテンツが重複していた場合、たとえそれが著作権を侵害しているか否か、あるいは出典の表示方法が正しくおこなわれているか否かにかかわらず、順位に著しい不利益を生じさせることがある。

自サイト内の重複

サイト作成でページ数が増えてくると、自分のサイト内でも重複が発生します。悪気がなくてもサイトを更新していくと似たような記事になってしまう事はよくあるのです。

グーグルはこのような場合でも重複扱いで、マイナス評価しますので、記事のタイトルや新しいページ、カテゴリーを作る場合は注意が必要です。

サイト作成の初期段階でサイト構成を十分に練る事がここでも重要になる訳です。

サイトコンテンツは完全オリジナル記事で作成せよ

サイトの読み込みが速度が遅い

私は40サイトほど運営していますが、その経験上、内部SEO対策の中でも顕著に検索順位に影響していると感じるのが、サイトの読み込み速度です。

あなたもご経験があると思いますが、検索でサイトをクリックしても「待て!」のマークがグルグル廻って開くのが遅い!戻るボタンを押したくなりますよね。

このイライラはユーザー側だけでなく、検索エンジンもそう感じているのです。

重いサイトは大抵どのページもリンクの反応が遅い傾向があり、ユーザーは常に待たされます。グーグルのクローラーもサイト内をリンクをたどって各ページを巡回しています。クローラーの巡回スピードも遅くなる訳ですね。

読み込み速度が遅いサイトはユーザーをイライラさせ、ページが閉じられやすく直帰率が上がり、クローラーもページをインデックスできないという事態が発生します。

サイトを開かれるまでのユーザーが我慢できる時間は3秒です。これ以上遅いと色々な原因が重なり、有益なサイトでも検索上位表示は危ぶまれます。

サイト規模がある程度大きくなった場合は読み込みスピードを確認しながら更新していく必要があります。サイトが重くなってきたと感じる場合は、原因を突き止めて改善していうようにして下さい。(サイトスピードはページごとの分析が必要です)

サイトが重くなる原因

- ファイルサイズが大きい画像が同一ページに多数存在する

- ユーチュブなどの動画を複数貼り付けている

- 安価なサーバー、無料サーバーを利用している

- JavaScriptを多用している

- サイトのレイアウトが複雑すぎる場合

原因の究明と解決のためのツール

■ グーグルアナリティクス

アナリティクスのサイドバー・・・ 行動 > サイトの速度

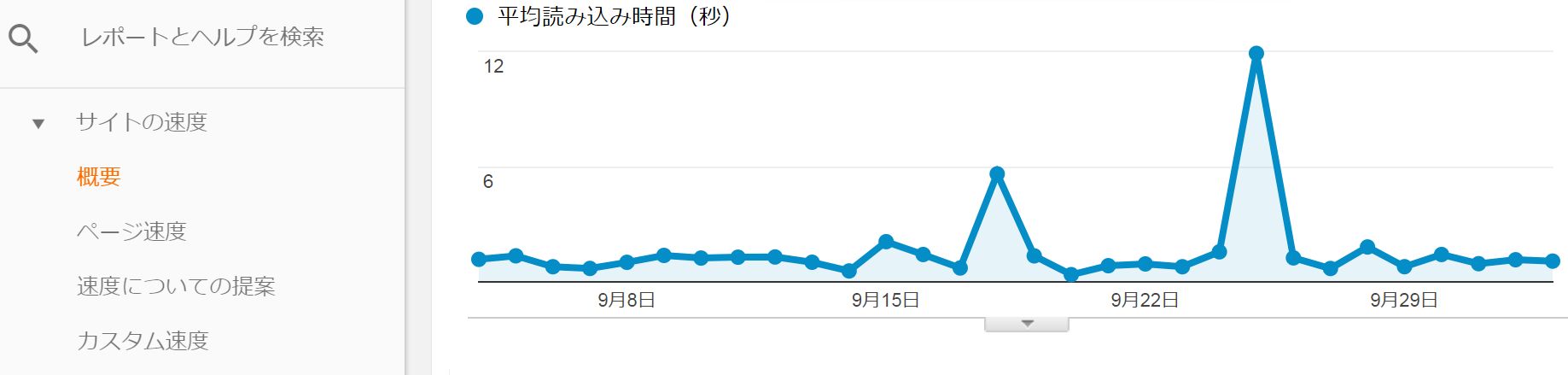

解析ツールグーグルアナリティクスでは、上記画像のように平均読み込み時間が日付ごとにグラフで表示されます。またページごとのサイトスピードの確認も可能であり、改善が必要なページではその対策まで提案してくれます。

■ ページスピードインサイト Page Speed Insights

グーグルのサイト速度チェックツールです。パソコン、スマホそれぞれの表示速度に点数が付き、それぞれ問題が発生している場合は、その改善方法まで表示されます。合格の目安は80点になります。

■ 画像圧縮ツール

私が愛用しているサービスサイトです。当サイトの画像はすべてこのツールで圧縮しています。画質を落とさず、JPEGやPNG画像を最小サイズに圧縮でき、複数枚の画像を一回の作業で処理できる無料の優れものツールです。

軽いサイトからすべてのSEOは始まる

サイトの動作不良

サイトの不具合のほとんどが内部リンクのエラーです。リンクそのものがタグの記述間違いで機能していないもの、飛び先が間違っているリンク、リンク先がエラーによりサイトが表示されない場合、これらはすべて内部リンクエラーと呼ばれます。

内部リンクエラーをそのままにしておくと、この事はクローラーの通り道を塞いでしまって、リンク先のページがインデックスされないという状況になります。

またリンクが正常に機能しないとユーザーに対しても不便ですし、グーグルアルゴリズムからもサイトの質が低いと判断されてしまいます。

また単独のリンクでしか繋がっていないページについては、検索上存在しない事になります。これはそのページが評価されないという事で、SEO的に大きなマイナスになります。

サイト作成中は、1ページごとにリンクをチェックし、完成した段階ですべてのリンクが正常に動作するかを確認するようにした方が良いです。

クローキングについて

サイトを自分で作成するようになり検索表示されるようになると、SEOの会社から営業で電話がかかってくる事がよくあります。しかし絶対に話を聞かないようにして下さい。

SEOの会社はグーグルのアルゴリズムの進化で、その数は減ってきています。しかし未だに古い手法でSEOを施している会社があります。その手法のひとつにクローキングというグーグルのガイドラインに違反した施策があります。

クローキングはサイトの動作不良であると言えます。検索エンジンとユーザーに対して、異なるコンテンツの情報を出し分けて検索エンジンの評価を高めようとするものです。

例をあげますと、検索エンジンにはSEOで有利になるテキストコンテンツを示し、ユーザーには画像やFLASHなど、デザインに優れたサイトを見せるという手法です。

故意にコンテンツを出し分けるという行為は、グーグルから見ればスパムサイトと判断する訳けです。これはサイトの大きな動作不良としても扱われ、サイトの評価は当然下がります。またクローキングがばれると、検索結果から抹殺されてしまいます。

SEO対策は自分の力でしかできなくなってきています。SEO会社は無視しましょう!

サイトのコンディション維持もSEO対策のひとつである

自動生成コンテンツと自動編集

オリジナルの文章と対照的に、プログラムを使い自動的に文章を生成したり編集できるソフトがあります。検索順位を上げるために、このようなソフトを使ってサテライトサイトを複数作成して、メインのサイトにリンクを送るSEO対策があります。

しかしこのような自動生成、編集された文章は、グーグルに見抜かれてペナルティを受ける事になります。現在ではAIを駆使し人間が書いたような精巧な記事でも、パンダアップデート以降自動生成の記事では、検索上位表示させるのは難しくなっています。

■ パンダアップデート [低品質なコンテンツを検索結果から除外するアルゴリズムの更新]

パンダアップデートの進化と、サイトの品質を分析する他のアルゴリズムとを合わせて、グーグルは自動生成でなくても、他サイトから記事を盗んで繋ぎ合わせた文章も、低品質なコンテンツと判断する能力をも持っています。

また、グーグルはサイトの離脱率の分析から、WEBライターに記事を書かせた場合においても、オリジナルコンテンツでない事を見破る技術を持っています。

なので現在では、完全オリジナルのコンテンツで構成され、かつその質が高いサイトでなければ、検索上位を狙えない状況になっています。

グーグルは確かに被リンクの分析によってサイトのクオリティの判断はしていますが、それより確実にコンテンツの質の比重の方が大きくなってきていると言えます。

まだまだネット上ではコンテンツ自動生成のソフトや、そのようなサービスを売りにしたSEOの会社が氾濫していますが、絶対に口車に乗らないようにして下さい。

知識の向上のための勉強がSEO対策につながる

どこにでもあるコンテンツ

検索上位にヒットするグーグルが求める記事の質が変ってきています。以前はそのサイトのメインのキーワードに係わるすべての内容についてより幅広く、より深く詳細に書かれたコンテンツをグーグルは好みました。

しかし、現在機能しているアルゴリズムで上位表示させるには、もう一段階上の指標を満足させる必要があります。これが「独自性」オリジナリティです。

グーグルはパンダアップデートの更新により、アルゴリズムがオリジナルの記事であるかどうかを判断できるようになり、検索順位を決定している事を公に発表しています。

現在でネット上でどれほどの競争相手のサイトがあるでしょう!その中で検索1位を獲得するのに一番有効なSEO対策が、独自性のある記事なのです。

みんなと一緒で、「ドングリの背比べ」ではダメなのです!

独自性、オリジナリティのある記事、コンテンツとはどのようなものか。

独自性というくらいですから、ネット上に氾濫していて、それを持ってきたかのような記事では、オリジナリティがあるとは当然判断してもらえません。

私がSEO上自身のサイト作成で解析、分析した結果での「独自性のある記事」の解釈は、自分自身の経験、体験、からくる思い、怒り、またある時は悲しみを交えた感情移入された記事であると感じています。

手前味噌で恐縮ですが、当サイトはビックキーワード、またその他の複合キーワードで、検索順位1位で表示されます。ありがたい事にニッチなワード検索でもトップページにたくさんのページが表示されるようになりました。

この理由がサイトを更新していくうちに徐々に解ってきました。

それは自分が使ったソフトを紹介しているという事です。逆に自分が知らない、使った事のない商品は全く記事にしていません。

またサイト作成に係わる無料のツール類も、自分が使って良いと感じたものだけを記事にして紹介するようにしています。反対に使った事はあるが、サイト閲覧者さんにはお勧めできないツールも数多くあったわけです。

要するに、自分の経験で良いと感じた物を厳選して記事にしているって事です。

また、お勧めできないツールは、自分の経験でお勧めできない理由も書いています。サイトを見てくれる人に対して自分の犯したミスや失敗を晒して、正しい判断をしてもらうと言うのがこのサイトの趣旨なのですね。

なので購入して失敗したツール紹介の記事は、特に感情がタップリ込められています。

これはお解りの通り、ツール購入にお金を払って、時間をかけて、使い方を覚えて、その上イヤな思いをして、結局役に立たないソフトの記事を書くのですから、感情はこれでもかというほど移入されています。

このため、このようなページは検索結果で長い間不動の1位をキープしています。

なぜかと言うと自分の体感記事なので、似たような記事がネット上でどこを探しても無いからです。この事をグーグルは独自性があると評価しているのですね。

ユーザーに役に立っている記事と判断された結果なのです。

私は使えないソフトでお金と時間を損をして、検索結果で利を得たわけです。

体感記事は、これほど記事の独自性をグーグルにアピールできます。

みなさんは自分のサイト上で「自社、あるいはお店」の、何らかの商品、サービスを扱っているはずです。そして今商売をしている以上色々な体験、経験を乗越えていらっしゃるはずです。このような体験はSEO上自分だけの宝物なのです。

是非それらの体感記事を作成して下さい。そう意識して記事を作成する事で検索で上位表示させる「コツ」が見えてくるはずです。

特に自分が失敗した経験はユーザーの役に立ちますのでSEOに活用して下さい。

百科事典のようなダサイサイトを作るな

背景色と同じ、または近い文字色を使用する

グーグルはスパムを嫌います。文字色が背景色と近い場合は隠しテキスト、リンクテキストの場合は隠しリンクと判断され、記事のコンテンツによるSEO効果が薄れます。

現在ではこのような隠しテキストは見られませんが、以前SEO対策としてよく用いられたキーワードのスパム的手法です。その気が無くともグーグルにこのような手法と勘違いされるので、ページ背景と文字色は明度差をハッキリ付けるようにしてください。

ホームページ作成を当初始められる方は自サイトの特色を出すために、色々な事がしたくなると思います。しかしよほどの理由がない限り、ページのバックの背景色は白、文字色は黒で作成されるのがお勧めです。

普通に記事を書いていても、大切な部分は赤、リンクは青になります。基本色とあわせて3色になりますが、これ以上他の色を使う事はお勧めしません。

それはデザイン的にチープになってしまうのと、そもそも記事が読みにくくなるからです。自分の納得ではなく、記事を読むのはユーザーである事を意識して下さい。

もし、どうしても背景に色を付けたい場合は、ごく薄い色にするべきです。よく女性の方で濃いピンクを使われる方が見受けられますが、閲覧していると非常に目が疲れます。

サイトデザインはSEO対策のひとつですが、懲りすぎるとSEOでプラスにならない事が多いです。綺麗なサイトを作成するべきですが、カラフルなのが綺麗ではありません。私の場合はバナーなどを含め「色の統一」がサイトデザインだと考えて作業しています。

ユーザーのサイト閲覧環境を考えろ

サブドメインとサブディレクトリ

サイトの規模を大きくしていくに当たって、関連サイトを作成する方法があります。この場合メインサイトのドメインを使い複数のサイトを運営しますが、その方法は2っあります。どちらを選択するかでSEOに大きく関係しますので注意が必要です。

■ 当サイトのURL・・・http://softsate.info/の例で解説します。

サブドメイン

http://seo.softsate.info/

※ seo.は任意の小文字英数字になります。

サブドメインはサーバーで取得しますので、メインのドメインを設定しているレンタルサーバーにログインして管理画面からサブドメインを取得します。

この場合メインのドメインを元に新しいドメインを取得した事になりますのでアルゴリズムはサブドメインサイトを元のドメインのサイトと全く別のサイトとして取り扱います。

別のサイト扱いになる事から、仮にサブドメインのサイトの価値があがり検索上位表示されたとしても、メインサイト(元のドメイン)にSEOの効果を与えません。

逆にサブドメインサイトがペナルティを受けたとしても、メインドメインサイトには影響がでません。クローラーはサブドメインサイトを独立したサイトとして扱うのです。

サブドメインで作成するサイトは、元のメインサイトの規模が大きく、そこから切り離して運営しても、単独でサイトとしてコンテンツが成り立つ場合に有効です。

余談ですが、無料ブログのサービスを利用する際、サブドメインの方がSEO効果が高いことが解ります。FC2とアメブロのURLを比べてみます。

■ FC2・・・サブドメイン形式

http://自分で決める文字配列.fc2.com/

■ アメブロ・・・サブディレクトリ形式

http://ameblo.jp/あなたのID/

無料ブログは多数の人が、様々なコンテンツで記事を書くため、カテゴライズとしては当然各ブログそれぞれがバラバラです。なので、単独サイトとして扱われるFC2の方が理にかなっていて、SEOとして優れている事が解ります。

ヤフーのサイトも、ニュースやショッピングなど、まったく異なるカテゴリーが複数あるので、サブドメイン形式で構成されています。

このような事から、ひとつのサイトの中において、同じカテゴライズのなかでサイト構成の規模を大きくし、またユーザー、サイト管理者が使いやすいサイトにする方法としてはサブディレクトリを選択する事がSEOでは有利になってきます。

サブディレクトリ

http://softsate.info/seo/

※ /seo・・・スラッシュの下。つまりフォルダの階層がひとつ下がります。

サブディレクトリはレンタルサーバーとは関係なく、現在のドメインの最上階層からひとつ階層を下げ、フォルダを作成し、その中にサイトデータを入れる事で作成します。

この場合メインサイトとサブディレクトリサイトは、アルゴリズムに判断された価値で、お互いに影響されます。例えばサブディレクトリサイトで検索上位に表示されるページがあれば、共通したキーワードでメインサイトの価値を押し上げるという事です。

このようにサブディレクトリのサイトは、メインサイトと親子関係となり、グーグルはひとつのまとまったサイトとして、その価値を判断します。

これはサブディレクトリが、メインサイトのひとつのカテゴリーフォルダとして扱われるためです。なのでシリウスのような作成ソフトでカテゴリーを作成する場合は、自動でサブディレクトリの中にindex.htmlが生成されているわけです。

ソフトでの操作の感覚としては、カテゴリーをページとして捉えがちですが、実質はメインサイトの中に、新しいサイトを作成している事になります。

参考までに、実際に今ご覧頂いている当ページのURLを見てみます。

http://softsate.info/algorithm/internal-minusfactor-algorithm.html

メインになるsoftsate.infoという最上階層の下に

algorithm・・・というフォルダを作成し、

その中に・・・internal-minusfactor-algorithm

というページが入っている。

このページを今あなたにご覧頂いているってことです。

サブディレクトリはサイト規模が大きくなる場合、サイト構成をまとめやすくなる利点があります。記事の内容が肥大化し、ページ数が増えそうな場合は、そのコテゴリーごとにページをまとめられるからです。

また、サイトの管理自体が楽になり、後の更新作業がスムーズに行えます。

ただ気をつける点がひとつあります。それはサブディレクトリの記事の内容が、最上階層つまりメインのコンテンツと共通している必要があることです。

この当ページはSEOのアルゴリズムについての記事です。これはドメインのキーワードが「サイト作成ソフト」であり、そのソフトを使う上での知識で、SEOが必要であり記事が共通していると言えます。なのでサブディレクトリで作成するわけです。

また逆にこのページをサブディレクトリで作成している以上、記事の内容やキーワード自体が「不動産関係」であってはならないという事ですね。もし「不動産関係」のサイトを、ドメインの派生で作成したいのなら、サブドメインでという事になります。

サイト規模を大きくしていく上で、このようにサブ的サイトの作り方を間違えると、後で取り返しが付かないので、十分気をつけて作業するようにして下さい。

サブサイト作成ではドメインの扱いに注意せよ

著作権違反

他サイトから無許可でコンテンツをコピーする事は著作権違反となり、このようなサイトはスクレイピングサイトと呼ばれ、グーグルからペナルティを受けます。

グーグルはコピーされたコンテンツについて、どちらがオリジナルなのかを判断するために、インターネット上に公開された時期や、サイトのクオリティを分析しいています。

またオリジナルの作成者が、著作権違反のサイトを発見した場合に、グーグルに対して通報できるシステムになっています。(重複コンテンツ参照)

■ デジタルミレニアム著作権法(DMCA)

- オリジナルコンテンツを不正コピーから守る法律

グーグルはこの法律に基付き、コピーサイトを通報システムにより手動対応で受付、容赦なくペナルティを与え、検索圏外に飛ばします。

ネット上のコンテンツ情報は参考程度にせよ

ドアウェイページ

ドアウェイページとは閲覧者さんを、ある特定のページに誘導するためだけに作られているページで、その目的が転送するためだけの低品質なページです。

このようなページは、オリジナルコンテンツの記述はなく、アクセスを流す事だけを目的に、特定のキーワードだけで作成されています。また、複合キーワードからのメインサイトへのアクセスを狙い、複数のサイトで構成されている事もあります。

グーグルはドアウェイページを、ユーザーに混乱を招くだけの価値がないページと判断し、ガイドラインに違反している検索スパムとして、ペナルティの対象にしています。

当然このようなサイトからのリンクはサイトの価値を下げます。

SEO対策をビジネスにしているの会社で、ドアウェイページからのリンクをSEO対策と称して販売しているところもありますので、十分注意が必要です。

メインサイトのクオリティを下げる被リンクは不要

過剰な広告とページレイアウト

サイトに広告リンクを貼る場合、その位置とトレイアウトの仕方によって、グーグルから定評価を受けて検索上位に表示されない事があります。

この判断をしているのがページレイアウトアルゴリズムです。

アルゴリズムが見ている場所は、検索でクリックしサイトが表示されて、スクロールされていない一番初めに閲覧者が目にする画面で、いわゆるファーストビューの位置です。

検索者は検索窓にキーワードを打ち込む事によって検索しています。その検索で、開いてすぐのページに広告が多く、メインコンテンツが画面をスクロールしないと見えない状態であると、アルゴリズムはこの事でユーザーに不便なサイトであると判断します。

閲覧者が目的の記事を探す事なく早くたどりつけるように、キーワードに係わるコンテンツを見やすい位置に配置するべきであるという考え方です。

なので、ページの上部は、フラッシュ、広告バナー、過剰な広告リンクの羅列などで埋まってしまわないようにする必要があるという事です。

またスクリプトなどを使って広告を表示させているサイトで、その動作が重くて開くのに時間がかかる場合も、サイトは定評価を受けます。

このようにページレイアウトアルゴリズムは、サイト利用者のユーザビリティの優劣を判断しています。ページ上部の過剰広告でユーザーに負担をかけないようにして下さい。

逆に言うと、目的の広告リンクをクリックしてもらいたいなら、まず検索者の希望するコンテンツを先に表示させ、有益な情報を優先的にユーザーに提供する方が有効的であり、クリック率を高くする事ができるはずです。

アルゴリズムのほとんどはユーザーの使い勝手を判断していると言えます。特にトップページのコンテンツのレイアウトは、他のアルゴリズムもスクリーンショットをする事によって監視しているのため、慎重に作業するようにして下さい。

ファーストビューにはメインコンテンツを記述せよ

過剰な内部リンクとフッターリンク

内部リンクがあまりに多すぎるとサイトの価値を低く判断される傾向があります。

グーグルが最も嫌うスパムリンクの傾向が、キーワードリンクの羅列であるため、これと同等であると判断されなければ良いって事になります。

目安ですが、この当サイトもカテゴリートップでリンクが目立ちますし、このカテゴリーのコンテンツのページトップでも、ページが縦に長くなる場合は目次として、20を超えるページ内の内部リンクが存在します。

当サイトを全体的に見た場合では190ページで300以上の内部リンクがあります。この状態で解析してもリンク過多になっているという事はないです。

目安としてお伝えするのは難しいですが、SEOを気にせずユーザーに便利に使ってもらえる事を意識して、適度な内部リンク付けであれば何の問題もないと考えて下さい。

また、フッターリンクも内部リンクのひとつです。

その性質からワードがページタイトルキーワードとなる事が多いですが、この場合でもキーワードの悪質な羅列であり、スパムと見なされるかどうかになります。

しかし通常のサイトでフッター部分のリンク数が、ページタイトルと「同じリンク数」くらいでしたら気にする事はありません。(私もそのようにしています)

しかし、フッターリンクを付けるという事は、その事自体でグローバルメニューと同ページでキーワードが重複するという事です。なのでそれ以上のユーザーが望まない記述は止めた方が良いという事は、お解かり頂けると思います。

内部リンクの最適化を考えろ

過剰なキーワード出現率と長いURL

SEO用語でスタッフィングという言葉があります。これはキーワードスパムの事で、必要以上にキーワードを連発記述する行為です。

スタッフィングは複合キーワードで検索結果に上位表示させる事を主な目的にしてると見受けられますが、現在アップデートされた何種類かのアルゴリズムは、この行為をスパムと見抜き、ユーザビリティに欠けるとして、サイトに低評価を与えます。

キーワードスパム

- タイトルタグ内に同じキーワードを複数回繰り返し記述する

- 見出し(H)内にキーワードを複数回繰り返えす

[例]○○駅近個別指導/個別指導の△△/個別指導で成績アップ - ALT属性に画像とは関連性がないキーワードを複数記述する

[例]学習塾の教室の画像にALTで、「地域の学校名、目標の受験校を連続記述」 - 長いアンカーテキストにキーワードを詰め込む

[例]個別指導の学習塾成績アップ保証学習塾学習塾○○のお問い合わせはこちら - 電話番号を連続で記述する

- 各ページBody内の上部に目的のキーワードを連発する

(メタキーワードについては現在グーグルは読み込んでいません)

[例]学習塾の○○学習塾の○○は△△市の学習塾で個別指導の学習塾です

上記のようなキーワードの過剰使用については、悪意がなくてもサイト作成初心者さんの場合に見られる事が多く、よく当サイトのお問い合わせでもお伝えしています。

URL内でもキーワードの過剰な繰り返しは、同様にスパムと判定される事があるらしいです。これが本当なのか実際に当サイトでビクビクしながら検証しています。検証で大きな変化がありましたら、またその時はご報告します。

当サイトでの実験用の検証URL

- http://softsate.info/homepage-creating/homepage-improvement/related-conflict-homepage.html

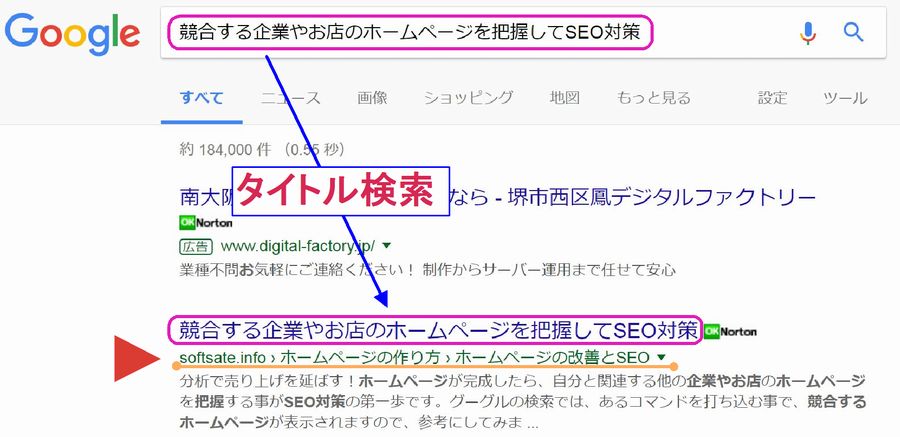

■ ページタイトル・・・競合する企業やお店のホームページを把握してSEO対策

■ キーワード・・・・・homepage

半年ほど検証してみるのでお楽しみに!

ご報告・・・半年後

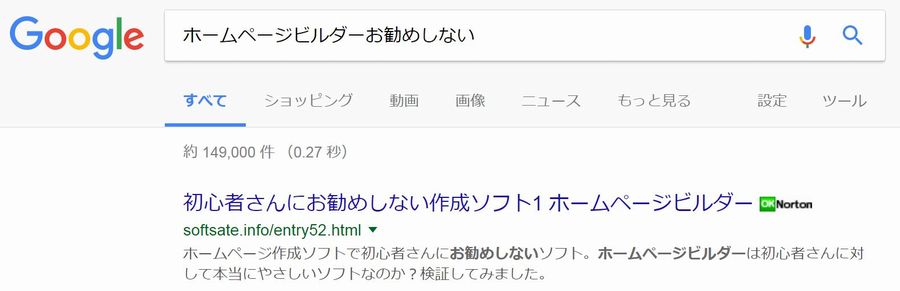

上記URLが長く、またキーワードhomepageの繰り返しでスパム判定を受けるのか、半年間解析で様子を見ました。警告や手動、自動ペナルティを受ける事なく、下記画像のように、タイトル検索ですが一応1位になっています。

スパム判定どころか、上記画像の赤い▲のページURL表示を確認して下さい。ご丁寧な事に、なんとドメイン以外のURLが日本語表記となっています。グーグル恐るべし!

この結果今回はセーフと言う事です。

セーフの原因と結果検証

- キーワードの繰り返しであるが、スラッシュで区切られている。

- homepageが和製英語であるため日本語に略された。

- カテゴリー内の第3階層ページなので、全体としてのURLの長さではなく、グーグルはラッシュ内でのURLの長さを考慮しているのではないか。

- 、、であれば、各階層ごとにキーワードを入れるのは問題ないかも。

実験による検証結果なので、今回はこのように解釈しても良いと考えています。あくまでも私の考察なので、参考程度にして下さい。

ユーザビリティに優れたキーワードの配置が上位表示の要因である

タイトルタグが長すぎる

SEOで有効なタイトルの書き方は、ページで一番大切なキーワードを初めの方に記述するようにし、続いて順番に重要なキーワードを並べるようにします。

アルゴリズムはタイトルテキストを読み込むとき、最初に書かれているキーワードが重要であると判断し、優先させます。だからと言って同じキーワードを繰り返したり、羅列する事は避けて下さい。2っ書いてもひとつしか読み込みません。

あくまでも、サイトの特徴などのアピールが最大限できる文章を考えた上、30文字までで記述して下さい。タイトルタグが長すぎる事がSEOでデメリットになる理由は、29文字を超えてしますと全部のテキストが表示されないからです。

その中でバランスよくキーワードを配置して下さい。

また、この事は内部リンクアンカーテキストにも同じ事が言えます。アンカーテキストは、リンク先を端的に表現したキーワードで記述するのが基本です。

しかしあまりにも長くまたキーワードを詰め込んだ内部リンクアンカーは、スパムと判断される可能性がありますので、この場合SEOでは当然不利になります。

適切なキーワード配列で、検索者に解りやすいタイトルを考え抜け

パークドメインと中古ドメイン

サイトがまだ完成いない状態でドメインを取得し、そのドメインにサイトを紐付けないで寝かせている状態をパークドメインと言います。グーグルはユーザーの利便性のため、このパークドメインを検索結果に表示させないうようにしています。

長く使われている中古ドメインが、そのドメイン年齢が高いという信頼性で、グーグルから高評価を受けると言う理由から、ドメインに対するSEO対策で、パークドメインを保有しておくと言うやり方があります。

しかし、グーグルは現在ドメイン年齢をサイトクオリティの評価の指標にはしていません。なのでパークドメインがSEO対策になるという事は一切ないという事です。

パークドメインを「ドメインを寝かせる」と言う表現で、それが未だにSEO対策に有効であると言う事を主張している情報商材等がありますが、まったくのウソです。

また、パークドメイン自体がSEOで不利になるという事実もありません。

ただパークドメインの期間中そのドメインに広告などを掲載しておき、収入を得るという手法を実践している方がいます。

しかし、そもそもパークドメインはインデックスされないので検索表示されず、誰の目にも止まらない事から、その広告の掲載はムダな行為と言えます。

パークドメインに、いよいよコンテンツが掲載され公開されると、クローラーが廻ってきたタイミングで、パークドメインが自動的に解除され、通常のサイトのドメインとして、グーグルのデータベースにインデックスされます。

このようにドメインの先取りは、SEOとは全く無関係であると言う事です。

中古ドメインについても、すでに被リンクされている事を理由に、そのSEO効果を期待して高いお金を出す人も見受けられますが、作成したサイトに関係しない被リンクはSEOに有効ではないので、こちらもムダな行為と言えます。

パークドメインをSEOで意識する必要はない

箇条書きが多すぎるコンテンツ

HTMLで箇条書きを記述する場合はリストタグを使用します。このタグは自動で数字が入る、入らないの2種類あり、状況によって使い分けます。

| HTML | サイト表示 |

|---|---|

|

<ul> |

|

| HTML 数字有り | サイト表示 数字有り |

|---|---|

|

<ol> |

|

「リストタグ」は「一般的な文章」で記述するより、「箇条書き」にしたほうが読みやすく、理解しやすい場合に利用します。次のような例が考えられます。

私が使った事のあるサイト作成ソフトは、最短ホームページテンプレートやサイト作成ソフトシリウスソフト、ホームページビルダー、ホームページV3、ドリームウィーバーで、ブログサイトの場合はテンプレート賢威などです。

上記の文章をリストタグを使い、箇条書きにします。

■ 私が利用経験のある作成ソフト

- 最短ホームページテンプレート

- サイト作成ソフトシリウスソフト

- ホームページビルダー、ホームページV3

- ドリームウィーバー

- ブログサイト場合・・・テンプレート賢威

このように同じ種類のワードが3っ以上並ぶ場合は、読みにくく、また読むのに疲れる文章になります。このような場合はリストにした方が視覚的に直感でそのワードが理解でき、ユーザビリティが高くなると言えるのです。

しかし、ストタグを使う場合の注意点があります。

それはリストの使い方を誤ると、グーグルにスパム行為と判断される場合もあると言う事です。グーグルはもともとキーワードの羅列や過剰な記述を嫌います。

どうしても箇条書きは、ワードの連続した並びになるので、そのワードがページタイトルやH1のキーワードと被った場合にアルゴリズムからは、スパムっぽく見えるのですね。

このように悪気がなくても、キーワードスパムと判断される場合もありますので、連発でリストタグを使い、箇条書きばかりを同じページで連続して使うのは避けて下さい。

ちなみに私は当サイトの「良くある質問」のカテゴリーページを目次のページとして作成し、すべての記述を箇条書きにしています。

これは箇条書きについて、どの程度の記述がSEOに不利になるかを検証してみたのですが、今のところカテゴリーページを含めたすべてのページが検索上位を維持しています。

しかし箇条書き連発によるキーワードスパム対策を実施している事を、グーグルはハッキリ公言しているので、ページの構成には十分注意して下さい。

箇条書きだけのページは作るな

アフィリエイトサイトでの販売者サイトとの記事重複

アフィリエイトサイトとは自サイト上の「商品レビュー」で販売者さんサイトをリンクで紹介し、そのサイトから購入が発生すると、利益の一部がアフィリエイトサイト運営者に還元されるシステムです。このシステムを利用するにはASPとの契約が必要になります。

■ ASP・・・アフィリエイトサービスプロバイダー

アフィリエイトサイトを運営するアフィリエイターと販売者を仲介する業者

インフォトップ・A8.net![]() ・電脳卸・インフォカート

・電脳卸・インフォカート

アフィリエイターが販売者の扱う商品をお勧めする記事(レビュー)の内容が、販売者サイトと極似していたり、コピーされている場合に、重複サイトとして扱われグーグルからオリジナリティが無いとして、低評価を受ける事があります。

アフィリエイトで扱える商品は様々ですが、レビュー記事の内容は、自分がその商品を利用した使用感などの感想や、メリットデメリットを訪問者に解りやすく伝える事が重要になります。なのでアフィリエイターは紹介する商品を使っている事が必須なのです。

レビュー記事は重複しやすいので気をつけろ

太文字や斜体文字などを多用する

記事中で重要な部分を太文字にしたり斜体文字、色付文字にしますが、やり過ぎに注意して下さい。クローラーはこれらの装飾タグが必要以上に多く使われていると、スパムとまではいきませんが、サイトに低い評価を与えます。

以前のクローラーは文字装飾をキーワードとして判断していましたが、現在ではその要素をアルゴリズムは考慮していません。また、装飾タグがあまりにも多くなり過ぎると、テキストに対するソース割合が長くなる事もSEOではマイナス要因のひとつになります。

一世代前は、太文字を表現するストロングタグ(<strong>太文字</strong>)は特に重要なワードであるということをグーグルに伝えるためのタグで、文中の利用割合などもSEO対策として考慮すべき事項でした。

しかし現在ではその意味は全く無いものと考えて頂いて結構です。なので太文字に対するタグはは<b>太文字</b>で記述して差し支えありません。

それよりユーザーに対して解りやすい文章になるよう装飾タグを使うようにして下さい。

ユーザーの閲覧に最適な装飾タグを使え

過剰な動的コンテンツ

インターネットの速度が非常に速くなった現在では、動画コンテンツ、フラッシュなど様々な表現をサイト上に掲載できるようになりました。またスクリプトで外部のコンテンツを読み込ませたり、CSSの駆使などで、サイトの使い勝手も変って来ています。

しかし、あまり動的コンテンツを使いすぎると、その重さでサイトの読み込みが遅くなるというデメリットも付きまといます。この事でクローラーの動きも悪くなります。

現在ユーチューブでは読み込みタイミングのコマンドが機能していないため、ユーチューブを埋め込む場合は、1ページに対して1本に留めておくべきです。

フラッシュもアニメのように複数枚のファイルサイズの大きい画像を連続して表示させる技術なので、やはり通常のトップバナーよりサイトは重くなります。

本来ユーザーはネットに対して一番に求めているものは、有益な情報の収集あり、過剰なサイトデザインを好んでいる訳ではありません。

逆にユーザーは予想しないサイトの動きに違和感を感じます。

なので、サイトに取り入れる動的コンテンツは必要最小限とし、シンプルで読みやすく、ユーザーが情報を得やすいように、デザインを最適化させることが重要と言えます。

また、サイトデザイン最適化は、サイトの表示スピードを早くする事にもSEO対策としてのメリットがあるので、作成しながらバランスを調節していきましょう。

サイトは静的に作成せよ

ポップアップウィンドウとインタースティシャル広告

まず、ポップアップウィンドウはホームページで別のページに飛ぶためリンクをクリックした場合や、ブラウザの戻るボタンを押した場合に、別ウインドウが勝手に開き、そのウインドウを閉じないと次に進めない不便な構造になっている一種の広告です。

一般的なラウザには、このポップアップウィンドウをブロックする機能がついています。

次にインタースティシャル広告ですが、これはページとページを移動する間に、強制的に独立した広告ページが挿入され、この広告を消すにはユーザーがクリックなど、次のコンテンツに飛ぶために、何らかの動作が必要になります。

インタースティシャル広告では、スマートホンやアイフォンなど携帯端末の場合に、画面全体に広告が表示表示されるため、ユーザーは大変不便な思いを強いられます。

このような事からグーグルは、インタースティシャル広告に対してペナルティを与え、広告を掲載しているサイトを、検索結果から排除するようになりました。

現在のところPCサイトは画面が大きく、広告がコンテンツの全部を隠す訳ではない事が理由で、厳しい規制はありませんが、今後ペナルティの対象になるかもしれません。

グーグルはコンテンツの閲覧を妨げるようなシステムを組み込んだサイトは低品質であると判断し、対応を厳しくしています。ポップアップウィンドウに対する評価も同じであり、即ペナルティは無いですが、検索上位は望めないと言う事です。。

また、このような広告のシステムや機能をサイトに取り入れると、サイトがグーグルに正しくインデックスされないと言う事態も発生します。全く良いところが無いですよね。

少しの利益のためにサイトを潰してしまわないようにして下さい。

サイトに余計な広告は貼るな

ペナルティを受けているサイトへのリンク

自サイトと関連する有益なサイトへのリンクはSEO上有効ですが、そのリンク先のサイトがペナルティを受けている場合や、グーグルから低品質なサイトであると判断されている場合、その発リンクはアルゴリズムからマイナス評価を受けてしまいます。

なので、発リンクを付ける場合は、リンク先のサイトをチェックする必要があるのですが、これは単純に発リンク先のサイトをURLで検索すればスグにわかります。

通常サイトはグーグルからの評価値かかわらず、URLで検索した場合は、必ずそのサイトが直接表示されます。しかしグーグルからペナルティを受けていたり、極端に低品質と評価を受けているサイトは、URLの検索でも表示されません。

念のため発リンクはURLチェックせよ

画像内、動画内のテキスト

アルゴリズムは画像内や動画の中で記述されているテキストを読み込む事ができません。

グーグルはサイトの情報をレンダリングにより解析していますが、これはあくまでもHTMLの情報が元になっていますので、HTMLの記述により画像である事は認識しても、その中のテキストまで読み取れないって事です。

そこで、画像の情報を、ソースでグーグルに教えます。これがaltタグです。

■ altタグ(説明文)・・・alt="画像の説明文"

画像はそのデザインでコンテンツを解りやすくしたり、リンク画像でユーザーを誘導したり、または、ただ単にイメージであったりする訳です。

しかしアルゴリズムは画像の説明文だけで、その存在意味を把握しているので、画像内に記述するテキストはユーザーに対してだけの利便性を考えれば良いと言う事になります。

グーグルに対しては、説明文がキーワードとして読み込まれるため、画像を適切にaltタグで表す事がSEO対策になります。しかし画像と関係のないテキストをキーワードとして詰め込んだりすると、スパム扱いになりますので、注意が必要です。

適切に記述されたalt属性はSEO上有効である